Dans cette section s’affiche l’intégralité des posts publiés par la ou les sources sélectionnée(s).

Sommaire :

Rappel : la plage de dates s'applique uniquement aux messages reçus, et non à la publication des posts.

Toutes les statistiques affichées dans les graphiques comprendront les messages reçus sur la plage de dates sélectionnée, indépendamment de la date de publication des posts.

Par ailleurs, vous verrez toujours par défaut les posts les plus récents. Vous pouvez trier en fonction d'autres critères.

Filtre des posts

Dans l'onglet post, il est possible de :

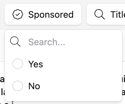

- Filtrer les posts Sponsored pour afficher uniquement les posts organiques sponsorisés (disponible seulement pour Facebook).

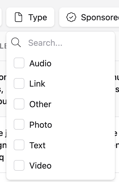

- Filtrer par Type (audio, Link, Other, Photo, Text ou video)`

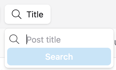

- Rechercher un post par son titre

Les caractères spéciaux (#, @, &, %, $ etc.) ne sont pas reconnus. Les recherches en comportant renverront un résultat d'erreur.

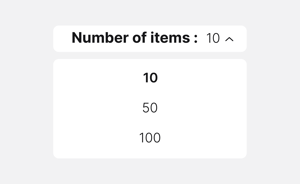

- Sélectionner le nombre de posts à afficher par pages (10, 50, 100).

- Trier les posts par critères :

- Latest : Posts les plus récents

- Les posts ayant généré le plus de commentaires de type Hate speech, Hateful, Neutral, Undesirable, Criticism, Positive, Message count (Total).

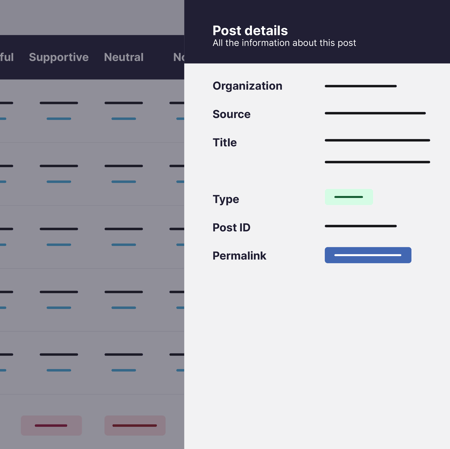

Détails des posts

Voici les informations auxquelles vous avez accès pour chaque publication :

- Cliquer sur la flèche pour avoir plus d'informations sur un post spécifique

- Lien vers un Post (Permalink)

Il est possible d’accéder au post original sur le réseau social ou plateforme en cliquant sur le Permalink dans le menu ci-dessus.

- En cliquant sur la ligne d'un post, vous accèderez à une page détaillant les statistiques de celui-ci.

Toutes les réponses à la publication sont affichées, ainsi que l'action prise, leur classification(s), leur sévérité, leur langue et leur date de publication.

Vous pouvez traduire n'importe quel message n'étant pas dans la langue indiquée par défaut dans votre navigateur en cliquant sur ![]() , et de revenir au commentaire original avec

, et de revenir au commentaire original avec ![]() .

.

La fonctionnalité de traduction des messages est disponible au sein du plan avancé. Si vous n'y avez pas accès, contactez notre équipe Customer Success afin d'y souscrire.

Vous pouvez utiliser ces boutons pour choisir votre affichage

Vous pouvez utiliser ces boutons pour choisir votre affichage

Les statistiques sont les mêmes que sur la page Analytics (diagramme circulaire ou histogramme), mais concernent ce post uniquement.

Les statistiques sont les mêmes que sur la page Analytics (diagramme circulaire ou histogramme), mais concernent ce post uniquement. Les messages sont les mêmes que sur la page Messages (catégorie, action prise, sévérité), mais concernent uniquement le post affiché. Vous pouvez aussi filtrer et supprimer/restaurer manuellement les messages.

Les messages sont les mêmes que sur la page Messages (catégorie, action prise, sévérité), mais concernent uniquement le post affiché. Vous pouvez aussi filtrer et supprimer/restaurer manuellement les messages.

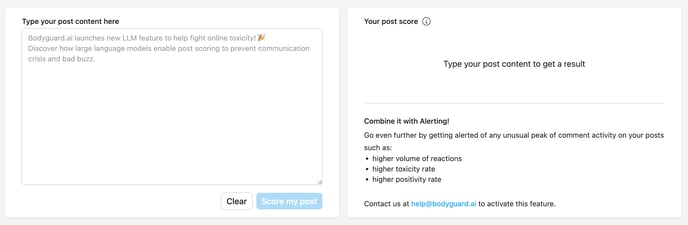

Score des posts

![]()

Une nouvelle bannière est maintenant affichée en haut de la page post, permettant d'évaluer la probabilité que votre post ne déclenche des réactions toxiques. Basée sur des années de données collectées, cette nouvelle technologie combinant les capacités techniques de Bodyguard et des grands modèles linguistiques (LLM) permet d'attribuer à un contenu un score de risque.

Pour y accéder, cliquez sur "score my post".

Sur la gauche de l'interface, vous pouvez directement taper le texte que vous souhaitez utiliser dans votre post (dans plus de 20 langues), puis cliquer sur "score my post" afin de générer un résultat. Les temps de chargement sont généralement courts, mais peuvent prendre jusqu'à quelques minutes selon la longueur du texte ou la complexité des termes utilisés.

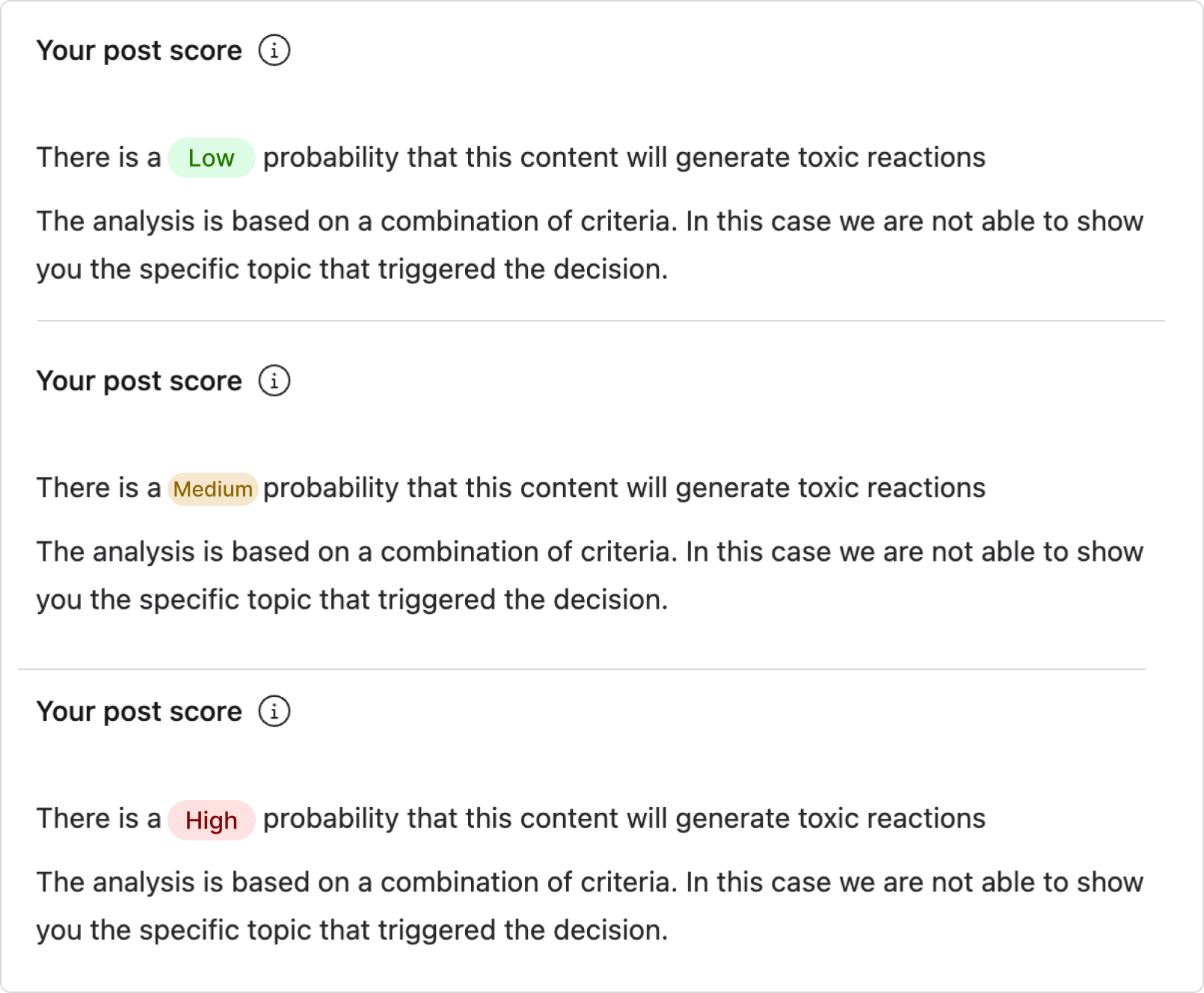

Une fois l'analyse terminée, vous obtiendrez l'un de ces 3 scores :

- Bas (low) : le score de votre contenu se situe entre 0 et 4, indiquant de faibles chances de générer des réactions toxiques.

- Moyen (medium) : le score de votre contenu se situe entre 4 et 7, pouvant indiquer que certains mots pourraient causer des réactions toxiques.

- Haut (high) : le score de votre contenu est au-dessus de 7, indiquant une forte probabilité que ce texte déclenche des réactions toxiques, puisque d'autres contenus similaires en ont généré.

Certains résultats sont détaillés, indiquant l'un des critères pris en compte dans l'analyse qui est la détection de mots à risque (dans le sens où ces mêmes mots ont provoqué des réactions toxiques dans le passé).